Python ile Yapay Zeka Geliştirme: Kütüphaneler ve Başlangıç Adımları

Python ile yapay zeka geliştirme, verileri anlamlandırmak ve makinelerin insan benzeri kararlar vermesini sağlamak amacıyla Python programlama dilinin sunduğu güçlü araçları ve algoritmaları kullanma sürecidir. Yapay zeka teknolojileri, modern dünyada tıbbi teşhislerden otonom sürüş sistemlerine, kişiselleştirilmiş alışveriş önerilerinden sesli asistanlara kadar hayatımızın her noktasında kritik bir rol oynamaktadır. Bu teknolojinin kalbinde yer alan Python, öğrenme kolaylığı ve geniş kütüphane desteği sayesinde hem yeni başlayanlar hem de profesyonel araştırmacılar için vazgeçilmez bir standart haline gelmiştir.

- Python’un yapay zeka dünyasındaki stratejik önemini kavrayacaksınız.

- Veri işleme, analiz ve görselleştirme için kullanılan temel kütüphaneleri tanıyacaksınız.

- Makine öğrenmesi ve derin öğrenme arasındaki temel farkları öğreneceksiniz.

- Kendi yapay zeka projelerinize başlamak için gereken kurulum ve hazırlık adımlarını keşfedeceksiniz.

- Python Tercihi: Okunabilirliği yüksek ve topluluk desteği çok geniştir.

- Temel Kütüphaneler: NumPy, Pandas, Scikit-learn ve TensorFlow en popüler araçlardır.

- Veri Seti: Yapay zekanın yakıtı kaliteli ve doğru işlenmiş veridir.

- Geliştirme Ortamı: Anaconda ve Jupyter Notebook başlangıç için idealdir.

Neden Yapay Zeka İçin Python?

Yapay zeka ve makine öğrenmesi projelerinde Python’un lider olmasının tesadüf olmadığını bilmek gerekir. Bir programlama dili olarak Python, karmaşık matematiksel işlemleri ve veri yapılarını oldukça basit bir sözdizimi ile ifade etmenize olanak tanır. Bu durum, geliştiricilerin kodun teknik detaylarından ziyade algoritmanın mantığına odaklanmasına yardımcı olur.

Ayrıca Python, dünya çapında milyonlarca geliştiriciden oluşan devasa bir topluluğa sahiptir. Herhangi bir hata ile karşılaştığınızda veya yeni bir yöntem denemek istediğinizde, internet üzerinde binlerce kaynak ve hazır çözüm bulmanız saniyeler sürer. Bu ekosistem, yapay zekanın sürekli gelişen doğasına mükemmel uyum sağlar.

Yapay Zekanın Temel Taşları: Kütüphaneler

Python’u yapay zekada bu kadar güçlü kılan asıl unsur, üzerine inşa edilen kütüphanelerdir. Kütüphaneler, daha önce başkaları tarafından yazılmış ve optimize edilmiş hazır kod bloklarıdır. Yapay zeka geliştirme sürecinde her şeyi sıfırdan yazmak yerine, bu uzmanlaşmış araçları kullanırız.

NumPy: Sayısal Hesaplamaların Temeli

NumPy, Python’da bilimsel hesaplamalar yapabilmek için kullanılan en temel kütüphanedir. Çok boyutlu diziler (arrays) ve matrisler üzerinde yüksek performanslı işlemler yapmanıza imkan tanır. Yapay zekada veriler genellikle matris formunda temsil edildiği için, NumPy bu dünyanın temel yapı taşıdır.

Pandas: Veri Analizi ve Manipülasyonu

Veri bilimcilerin en çok vakit geçirdiği kütüphane Pandas’tır. Excel tablolarına benzer şekilde çalışan “DataFrame” yapısı ile verileri filtreleyebilir, temizleyebilir ve analiz edebilirsiniz. Gerçek dünyadaki veriler genellikle eksik veya hatalıdır; Pandas bu sorunları çözmek için mükemmel fonksiyonlar sunar.

Matplotlib ve Seaborn: Veri Görselleştirme

Bir yapay zeka modelini eğitmeden önce veriyi anlamak şarttır. Matplotlib ve Seaborn kütüphaneleri, karmaşık sayı dizilerini grafiklere, dağılım haritalarına ve ısı haritalarına dönüştürür. Görselleştirme, verideki gizli desenleri (pattern) görmenizi sağlar.

| Kütüphane Adı | Kullanım Amacı | Önemli Özelliği |

|---|---|---|

| NumPy | Matematiksel İşlemler | Hızlı dizi ve matris işlemleri |

| Pandas | Veri Yönetimi | Tablo tabanlı veri işleme |

| Scikit-learn | Makine Öğrenmesi | Klasik ML algoritmaları |

Makine Öğrenmesine Giriş: Scikit-learn

Makine öğrenmesi (Machine Learning), verilerden öğrenen ve tahminlerde bulunan algoritmalar bütünüdür. Python ekosisteminde Scikit-learn, bu algoritmaların neredeyse tamamını içeren kapsamlı bir kütüphanedir. Regresyon, sınıflandırma ve kümeleme gibi temel görevler için kullanılır.

Örneğin, bir evin özelliklerine bakarak fiyatını tahmin etmek istiyorsanız “Lineer Regresyon” algoritmasını kullanabilirsiniz. Veya bir e-postanın spam olup olmadığını anlamak için “Destek Vektör Makineleri” (SVM) algoritmasından yararlanabilirsiniz. Scikit-learn, tüm bu karmaşık süreçleri sadece birkaç satır kod ile gerçekleştirmenizi sağlar.

Diyelim ki elinizde çiçeklerin taç yaprak uzunluklarına göre türlerini belirleyen bir veri seti var. Scikit-learn kullanarak bu veriyi modele verirsiniz, model kalıpları öğrenir ve yeni bir çiçek geldiğinde onun hangi türe ait olduğunu yüksek doğrulukla tahmin eder.

Derin Öğrenme ve Modern Yapay Zeka

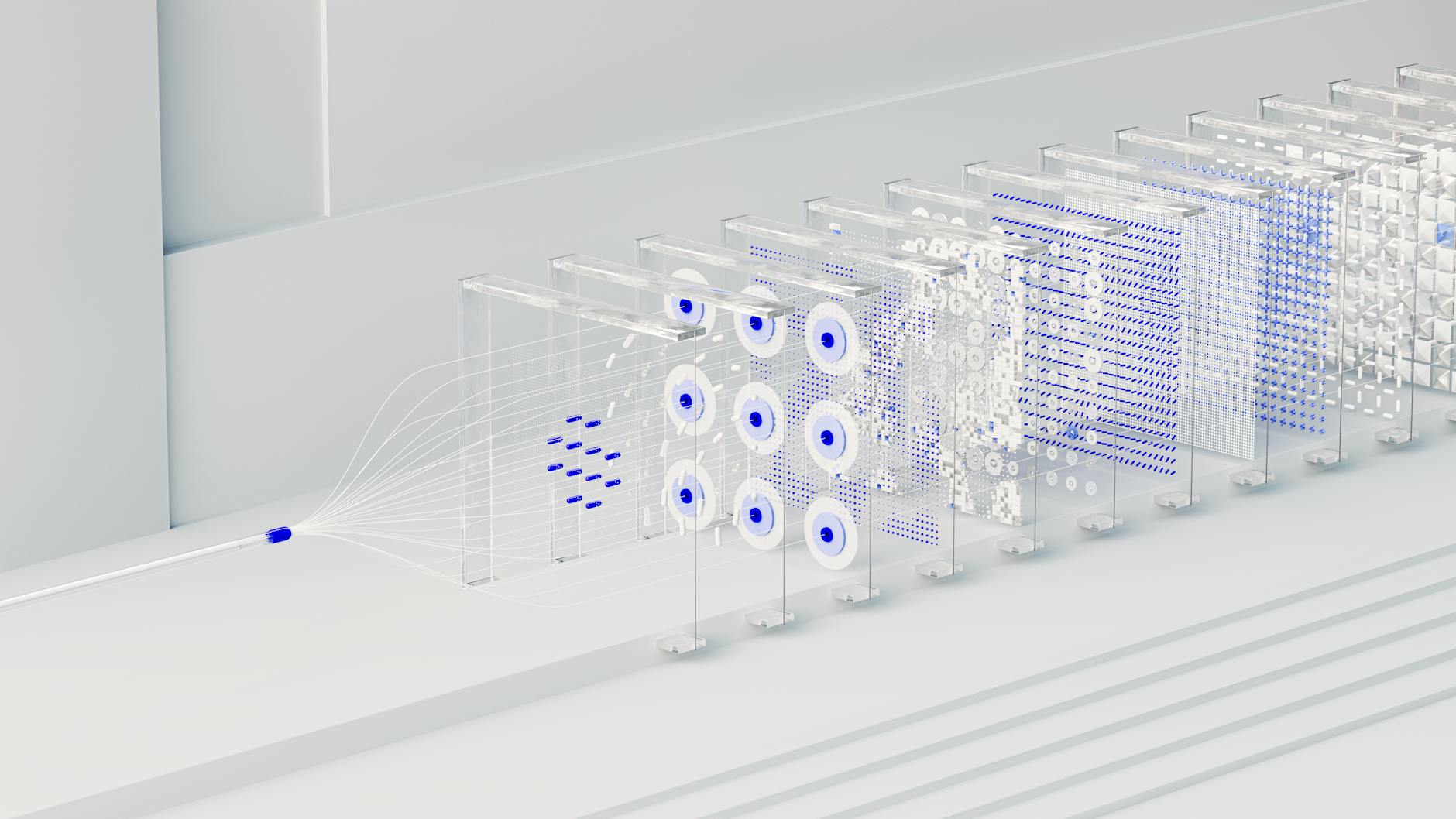

Derin öğrenme (Deep Learning), insan beyninin çalışma yapısını taklit eden yapay sinir ağlarına dayanan bir makine öğrenmesi alt dalıdır. Özellikle görüntü tanıma, doğal dil işleme ve karmaşık strateji oyunlarında (satranç, Go gibi) devrim yaratmıştır.

Bu alanda en çok öne çıkan kütüphaneler TensorFlow ve PyTorch‘tur. TensorFlow, Google tarafından geliştirilmiş olup endüstriyel ölçekteki projelerde yaygın kullanılır. PyTorch ise Meta (Facebook) tarafından geliştirilmiştir ve esnek yapısı nedeniyle akademik araştırmalarda daha sık tercih edilir. Başlangıç seviyesindeki öğrenciler için Keras (TensorFlow’un üzerine kurulu daha basit bir yapı) harika bir giriş noktasıdır.

Veri Önişleme: Yapay Zekanın En Kritik Adımı

Yapay zeka modellerinin başarısı, onlara verdiğiniz verinin kalitesine doğrudan bağlıdır. “Çöp girerse çöp çıkar” (Garbage In, Garbage Out) prensibi bu alanda altın kuraldır. Veri önişleme, ham veriyi modelin anlayabileceği ve işleyebileceği temiz bir formata getirme sürecidir.

Bu aşamada yapılan temel işlemler şunlardır: Eksik verilerin doldurulması, aykırı değerlerin (outliers) temizlenmesi, metin verilerinin sayısal değerlere dönüştürülmesi ve verilerin belirli bir ölçeğe (0 ile 1 arası gibi) getirilmesi. Pandas ve Scikit-learn bu işlemler için gelişmiş fonksiyonlar sunar.

Başlangıç Adımları: Kendi Laboratuvarınızı Kurun

Python ile yapay zeka geliştirmeye başlamak için bilgisayarınızda uygun bir ortam hazırlamanız gerekir. En popüler yöntem Anaconda dağıtımını kurmaktır. Anaconda, Python ile birlikte yapay zeka için gereken hemen hemen tüm kütüphaneleri otomatik olarak yükler.

Kod yazmak için ise Jupyter Notebook veya Google Colab kullanmanızı öneririz. Bu araçlar, kodunuzu hücreler halinde çalıştırmanıza, notlar almanıza ve grafiklerinizi anında görmenize olanak tanır. Özellikle Google Colab, internet tarayıcısı üzerinden çalıştığı için bilgisayarınızın gücü yetersiz olsa bile Google’ın sunucularındaki ücretsiz GPU’ları kullanmanıza imkan sağlar.

Yapay Zeka Modeli Nasıl Geliştirilir?

Bir yapay zeka projesinde izlenen standart adımlar şu şekildedir: Öncelikle problem tanımlanır (Örn: Bu resimdeki nesne nedir?). Ardından veri toplanır ve Pandas ile temizlenir. Veri seti, eğitim ve test seti olarak ikiye ayrılır. Model, eğitim seti ile “eğitilir” ve ardından test seti ile ne kadar doğru tahmin yaptığı ölçülür.

Eğer modelin başarısı düşükse, parametreler üzerinde oynamalar yapılır veya farklı bir algoritma denenir. Bu süreç, istenen doğruluk oranına ulaşana kadar devam eden döngüsel bir süreçtir. Unutmayın, en iyi model her zaman en karmaşık olanı değil, probleme en uygun olanıdır.

Pratik Yapma Zamanı

Öğrendiğiniz teorik bilgileri hayata geçirmek, yapay zeka dünyasında kalıcı olmanın tek yoludur. Kendi projelerinizi geliştirirken hata yapmaktan korkmamalı, hataların çözümünü ararken konuyu daha derinden kavradığınızı fark etmelisiniz.

- Python’un yapay zeka projelerinde diğer dillere göre en büyük avantajı nedir?

- NumPy ve Pandas kütüphaneleri arasındaki temel fark nedir?

- Veri önişleme (preprocessing) adımı neden modelin başarısı için kritiktir?

- Derin öğrenme projelerinde neden GPU (Grafik İşlem Birimi) kullanımı tercih edilir?

- Scikit-learn kütüphanesi hangi tür öğrenme algoritmaları için kullanılır?

- Python: Basitliği ve zengin kütüphane ekosistemi ile yapay zekanın dilidir.

- Kütüphane Gücü: NumPy sayısal veri, Pandas tablo yönetimi, Scikit-learn ise modelleme için kullanılır.

- Veri Kalitesi: Modelin başarısı, veri temizliği ve önişleme aşamasına sıkı sıkıya bağlıdır.

- Gelişim Süreci: Veri toplama, temizleme, eğitim, test ve optimizasyon adımlarından oluşur.

- Derin Öğrenme: Karmaşık veriler (ses, görüntü) için TensorFlow ve PyTorch gibi araçlar kullanılır.